DeepSeek R1 接入 SillyTavern 小酒馆:Ollama 本地部署教程

在 Windows 上用 Ollama 运行 DeepSeek R1,并把 SillyTavern 小酒馆连接到本机模型服务,包含模型选择、显存要求、API 配置和常见问题。

DeepSeek R1 出来之后,很多人会自然想到两个玩法:一个是在网页或 API 里直接使用官方模型,另一个是把开源模型跑在本机,再接入 SillyTavern 小酒馆做角色聊天。

这篇记录的是第二种方案:在 Windows 上用 Ollama 本地运行 DeepSeek R1,再让 SillyTavern 连接本机的 Ollama 服务。它的好处是不用把对话发到云端,折腾成本也不高;缺点也很明确,本地硬件决定体验,普通电脑跑小参数模型可以玩,想要接近官方满血模型的效果并不现实。

如果没有较强显卡,或者只是想快速在小酒馆里用 DeepSeek,直接使用官方 API 更合适,完整方案见 DeepSeek API 接入 SillyTavern:不用本地显卡的小酒馆方案。

适合什么配置

先把结论放前面:

- 只想体验小酒馆角色聊天,可以从

deepseek-r1:8b或deepseek-r1:14b开始。 - 显存有 24GB 左右,可以尝试

deepseek-r1:32b。 - 70B 以上版本对个人电脑压力明显变大,不适合多数普通本地环境。

- 官方 DeepSeek 网页和 API 使用的是更大规模的线上模型,本地蒸馏版不能直接等同。

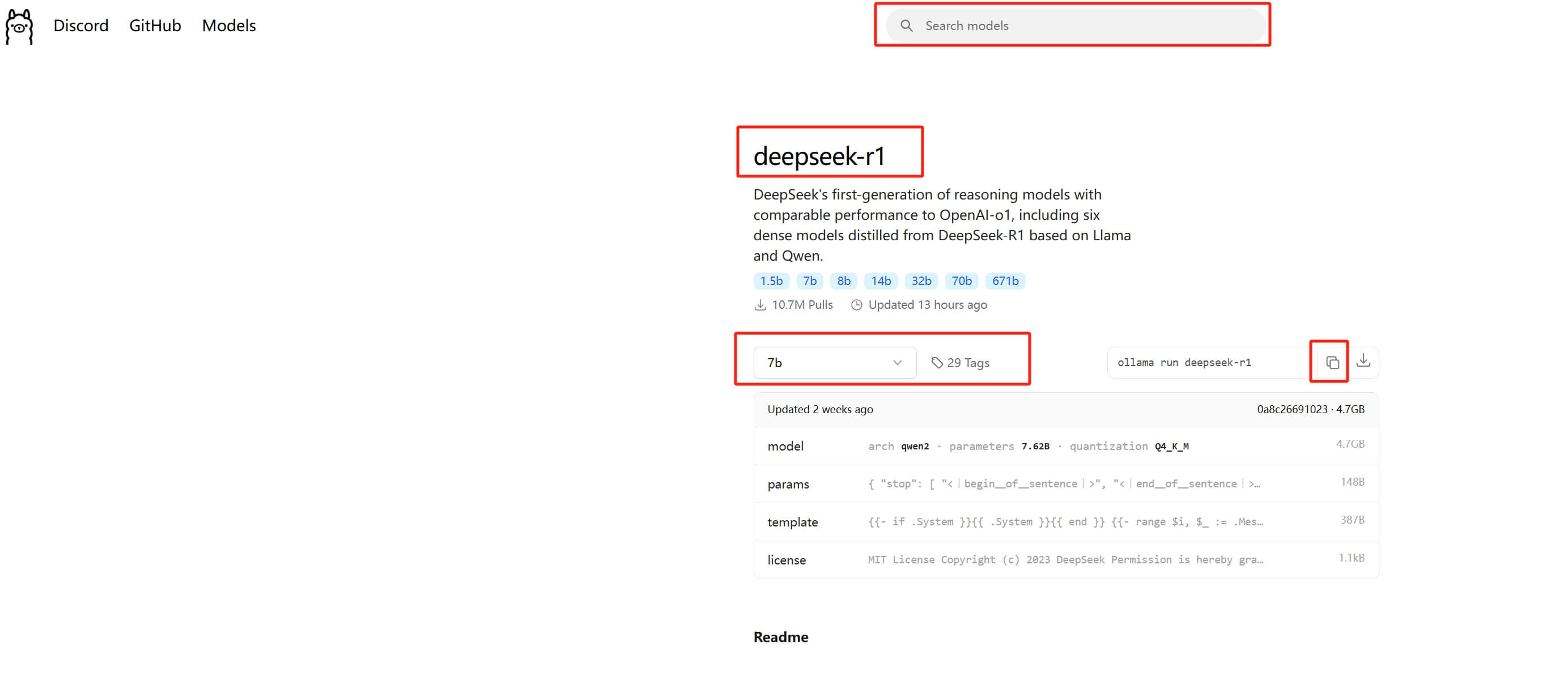

Ollama 的 DeepSeek R1 页面会列出当前可用的模型版本和体积,以官方页面为准。截至 2026 年 5 月 5 日,页面上能看到 8b、14b、32b、70b、671b 等版本,其中 32b 模型体积约 20GB,已经比较适合 24GB 显存机器尝试。

安装 SillyTavern

SillyTavern 是一个面向角色聊天和角色卡管理的 Web UI。它本身不提供大模型推理能力,而是连接到 OpenAI、DeepSeek、Ollama、KoboldCPP、LM Studio 等后端服务。

官方仓库地址:SillyTavern/SillyTavern

Windows 上通常需要先安装两个基础依赖:

SillyTavern 官方文档建议普通用户使用 release 分支。打开命令行,找一个非系统目录的位置,例如用户目录或文档目录,然后执行:

git clone https://github.com/SillyTavern/SillyTavern -b release

如果 GitHub 的 HTTPS 拉取不稳定,也可以配置 SSH key 后改用 SSH 地址:

git clone git@github.com:SillyTavern/SillyTavern.git -b release

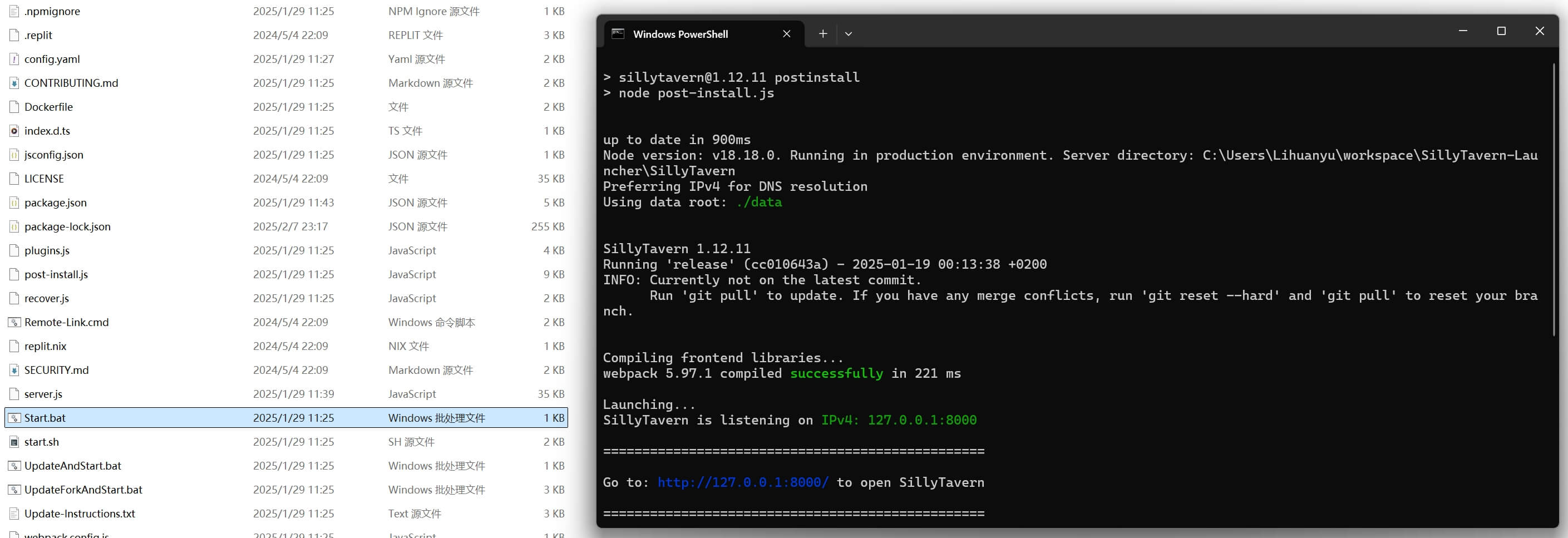

进入 SillyTavern 文件夹后,双击 Start.bat。第一次启动会安装依赖,完成后通常会自动打开浏览器。

到这里,小酒馆的界面已经可以打开,但它还没有连接任何模型。接下来需要准备本机 LLM 服务。

通过 Ollama 运行 DeepSeek R1

Ollama 是一个本地模型运行工具,安装、下载模型和启动模型都比较直接。官网下载地址:ollama.com

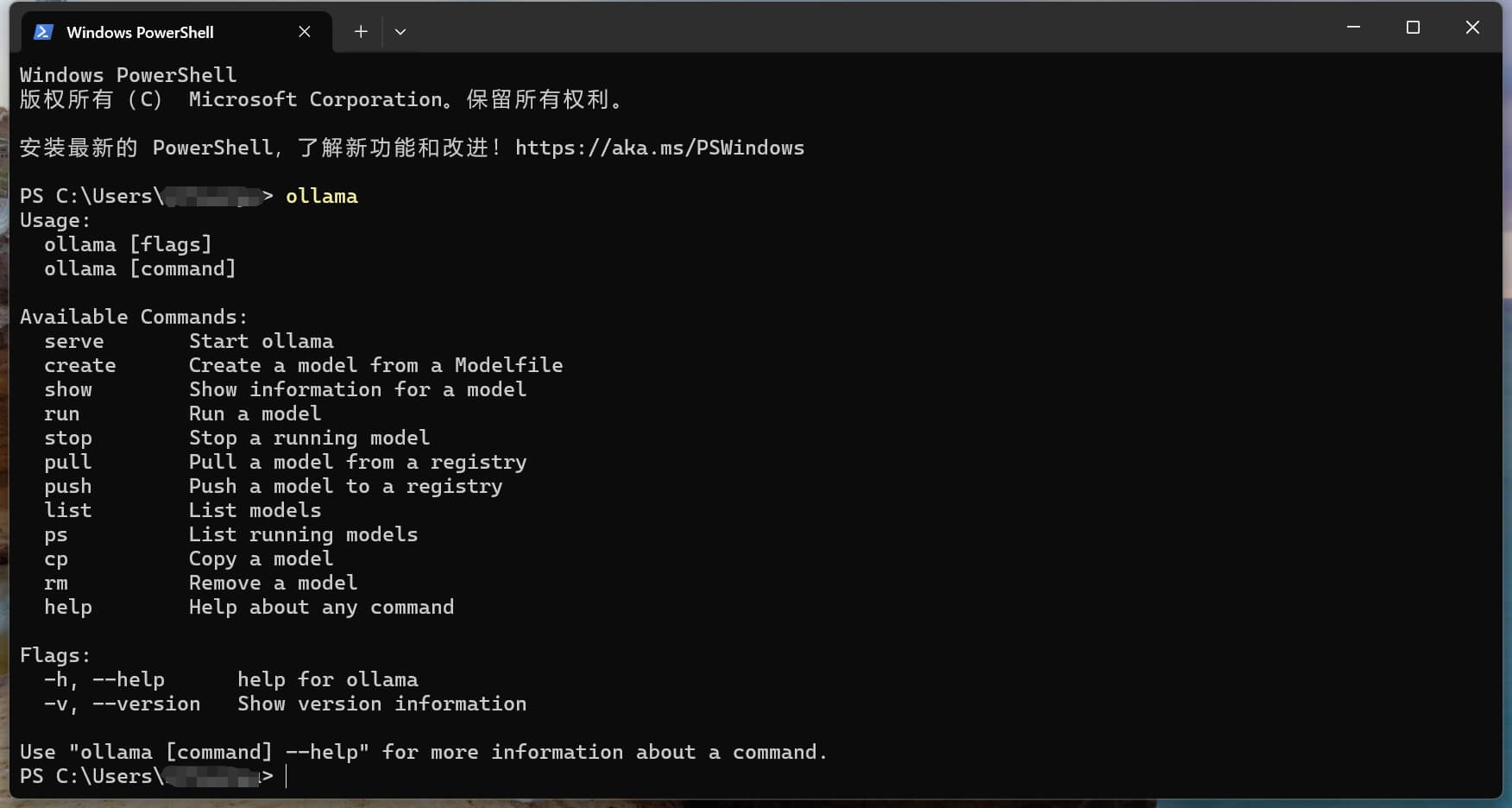

安装完成后,Windows 右下角托盘区会出现 Ollama 图标,表示本机服务已经启动。在命令行输入:

ollama

如果能看到命令帮助,说明安装正常。

接下来打开 Ollama 的 DeepSeek R1 模型页面,选择合适版本:

例如使用 32B 版本:

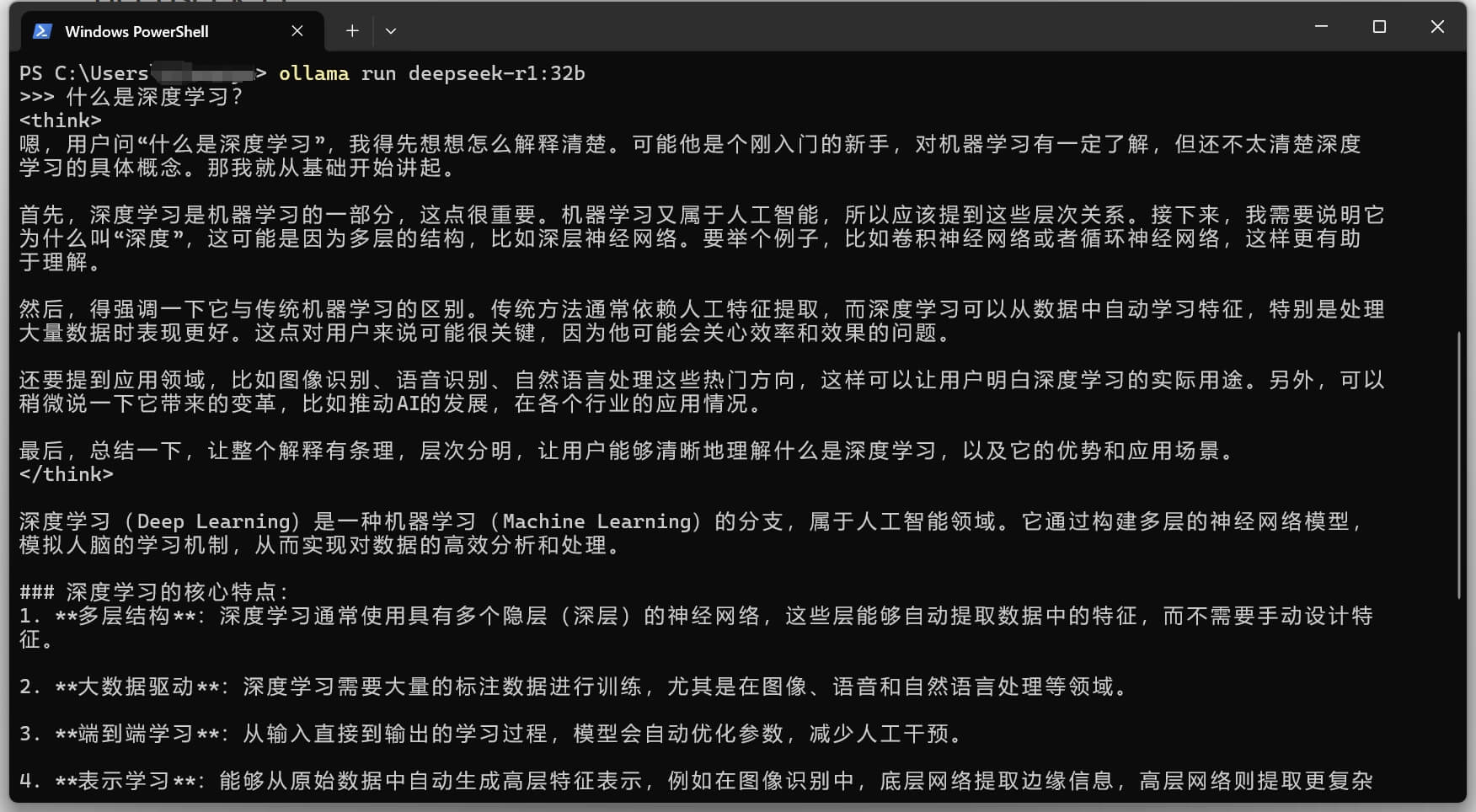

ollama run deepseek-r1:32b

第一次运行会自动下载模型文件,耗时取决于网络和模型大小。我的机器是 RTX 4090,24GB 显存,跑 32b 版本比较流畅;如果显存更小,建议从 8b 或 14b 开始。

需要注意,Ollama 本地运行的是开源权重或蒸馏模型。它适合学习、测试和个人玩法,但和 DeepSeek 官方网页、官方 API 上的线上模型不是同一个体验等级。真正依赖稳定效果和长时间使用的场景,优先考虑官方 API 或其它云端模型服务。

连接 SillyTavern 和 Ollama

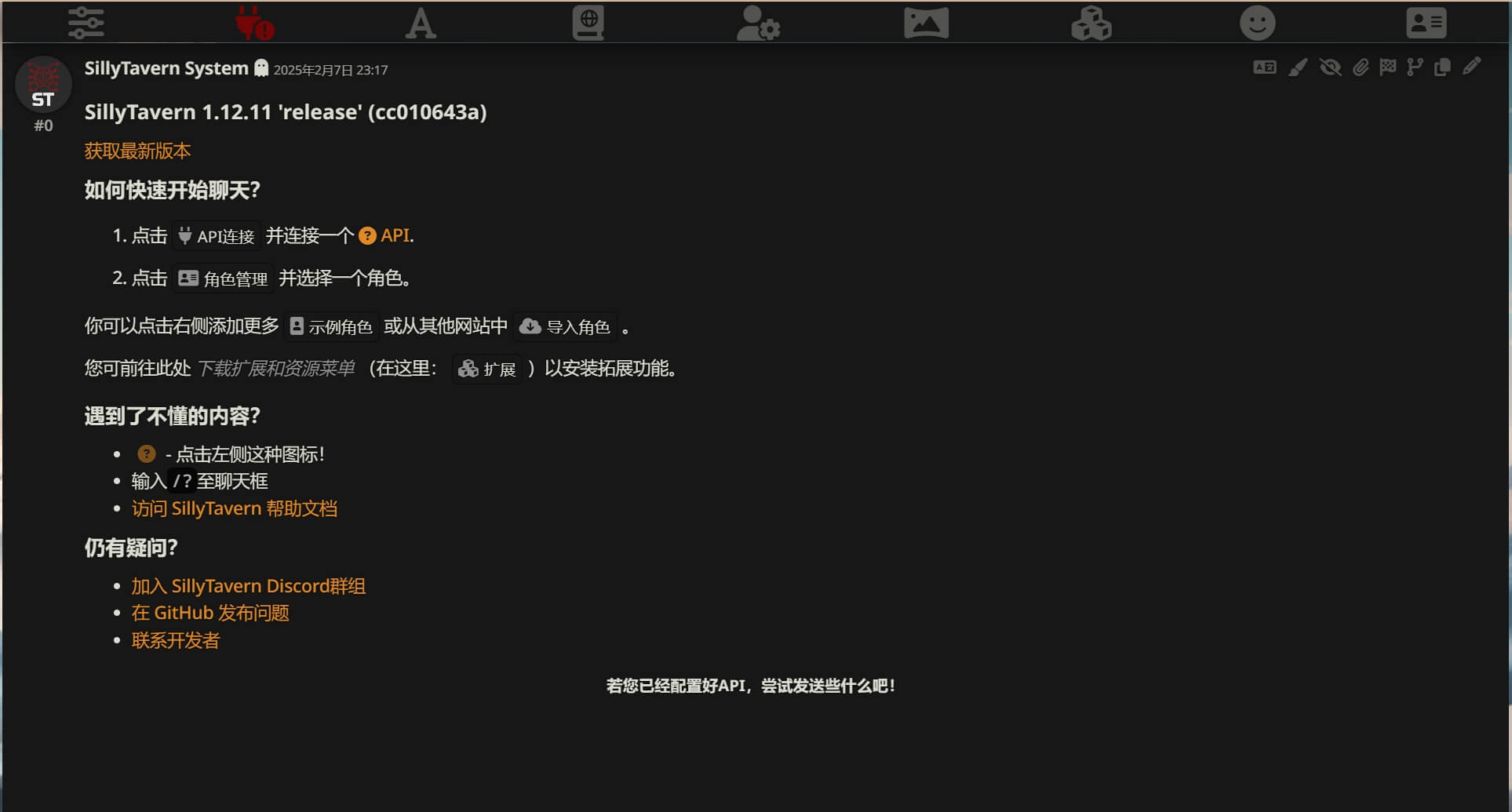

小酒馆运行后,页面大概是这样:

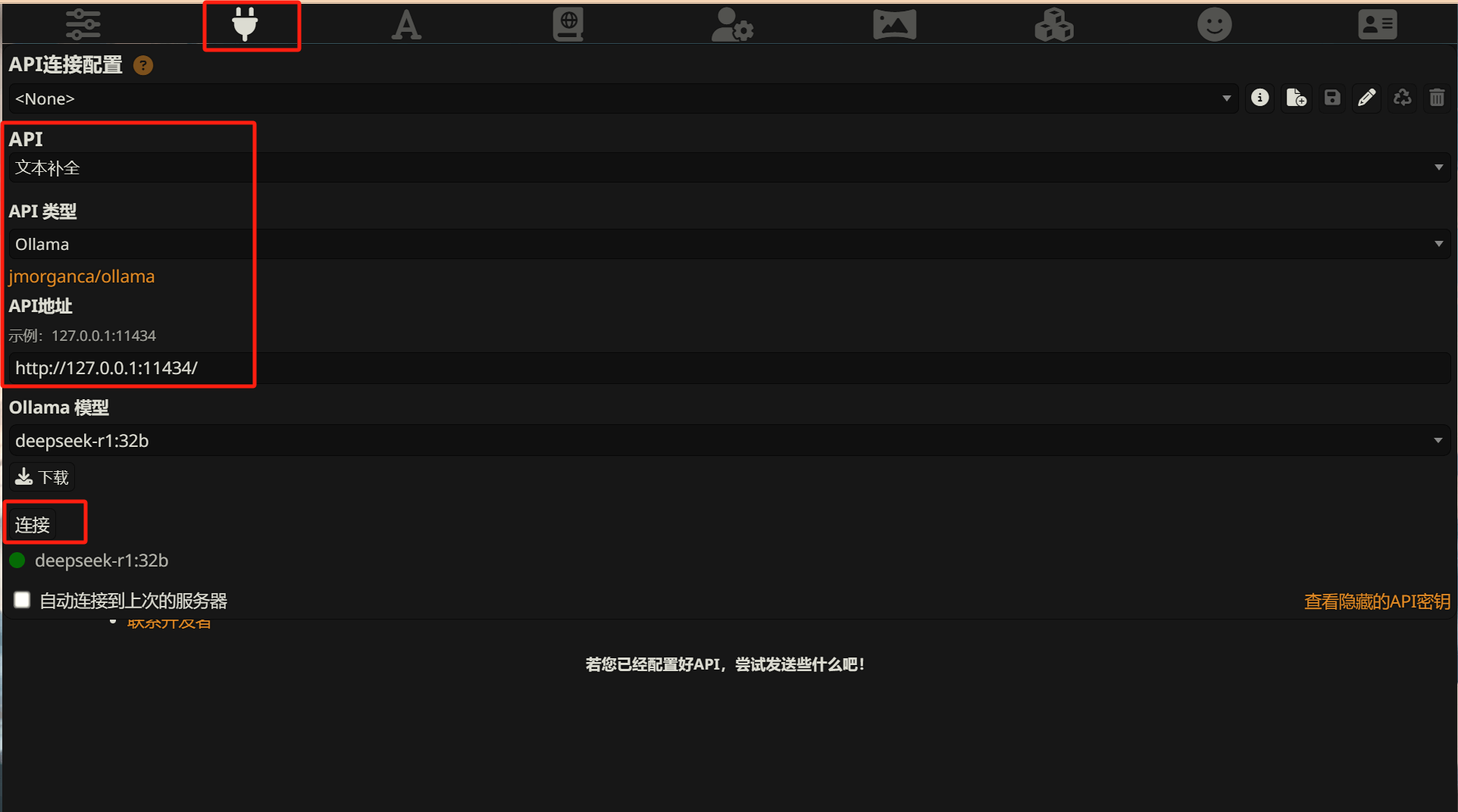

点击顶部的插头图标进入 API 连接配置。不同版本 UI 文案可能会变化,但核心配置大致是:

- API 类型:选择 Text Completion 或 Chat Completion 中支持 Ollama 的选项。

- 后端服务:选择 Ollama。

- API 地址:通常是

http://127.0.0.1:11434。 - 模型:选择或填写刚才运行的模型,例如

deepseek-r1:32b。

看到绿色状态、模型列表或测试连接成功,就说明 SillyTavern 已经连上本机 Ollama。之后可以选择角色卡开始聊天。

如果没有看到模型,先在命令行确认:

ollama list

如果列表里没有目标模型,先执行一次:

ollama run deepseek-r1:8b

确认模型能在命令行正常回复,再回到 SillyTavern 刷新连接。

常见问题

DeepSeek 小酒馆必须本地部署吗?

不必须。本地部署适合有显卡、想离线或想折腾模型的人。没有显卡时,官方 API 更省事,体验也通常更稳定。API 方案见 DeepSeek API 接入 SillyTavern:不用本地显卡的小酒馆方案。

7B、8B、14B、32B 应该选哪个?

按显存和耐心选。小参数模型响应更快、资源要求低,但角色理解、长上下文和复杂表达会弱一些。大参数模型效果更好,但下载体积、显存占用和等待时间都会上升。普通体验可以先从 8b 或 14b 开始,确认链路跑通后再换更大的版本。

SillyTavern 连接 Ollama 后没有模型怎么办?

先确认 Ollama 服务是否启动,再确认模型是否已经下载。命令行里执行 ollama list,能看到模型才说明本机存在这个模型。还要检查 SillyTavern 里的地址是否是 http://127.0.0.1:11434,不要把模型页面地址或 GitHub 地址填进去。

本地版本和 DeepSeek 官方 API 哪个更好?

本地版本胜在可控、隐私感更强、没有按 token 计费;官方 API 胜在效果、稳定性和硬件门槛。角色聊天如果只是娱乐和测试,本地模型很好玩;如果希望长期使用,API 方案更省心。

其它本地工具

除了 SillyTavern,普通问答也可以用 Page Assist 这类浏览器插件连接 Ollama。它更像一个本地 ChatGPT 界面,适合日常问答和简单搜索增强。

如果想尝试更多本地推理工具,也可以看看 KoboldCPP 或 LM Studio。Ollama 胜在简单,KoboldCPP 和 LM Studio 在模型管理、界面和参数配置上会更丰富。